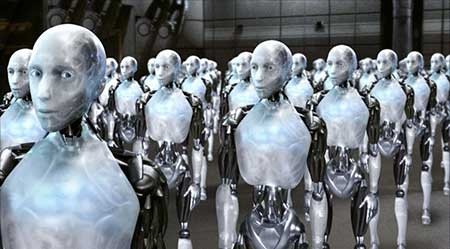

تیمی از محققان دانشگاه تافتز، دانشگاه براون و "موسسه پلیتکنیک رنسلر" با همکاری نیروی هوایی آمریکا در تلاشی چندین ساله به دنبال بررسی این نکته هستند که چگونه میتوان روباتهای اخلاقمدار تولید کرد.

در صورت موفقیت این پروژه، محققان میتوانند هوش مصنوعی خلق کنند که قادر به ارزیابی خودکار موقعیتی دشوار و اتخاذ تصمیمهای اخلاقی پیچیده باشد که بر دستورالعملهای سختگیرانه غلبه کند.

تیم تحقیقاتی به رهبری پروفسور ماتیاس شئوتز از دانشگاه تافتز در تلاش جهت طراحی چارچوبی برای منطق اخلاقی انسانی در روباتها هستند. پس از آن، تیم علمی تلاش میکند این چارچوب را در الگوریتمی مدلبندی کند که میتوان آن را در هوش مصنوعی تعبیه کرد.

این زیرساخت به روبات امکان غلبه بر دستورالعملهایش را در رویارویی با موقعیت جدید میدهد و فعالیتهایش را برای کنترلگرهای انسانی توجیه میکند.

در چشمانداز دانشمندان، همه تصمیمات روبات نخست با استفاده از سامانهای شبیه به سیستمهای موجود در پیشرفتهترین سیستم پرسش و پاسخ هوش مصنوعی مانند ابررایانه واتسون آیبیام، بررسی اخلاقی ابتدایی میشود.

چنانچه کمک بیشتری لازم باشد، روبات به سیستمی متکی خواهد بود که شوئز و همکارانش در تلاش برای مدلسازی پیچیدگی اخلاق انسانی، در حال طراحی آن هستند. این فناوری نخست به روباتهای پزشکی با هدف کمک به سربازان حاضر در میدان جنگ اعمال میشود.